AMD的AI策略与Intel和Nvidia有何不同?

2019-08-26

14:13:54

来源: 互联网

点击

AMD在Hot Chips期间并没有获得巨大的关注,这或许是因为在当今AI大热的情况下,他们采用“观望式”的AI策略。

Hot Chips 31本周在美国硅谷举办,两款最大的芯片发布引人注意。分别是Cerebras最大的深度学习芯片WSE,还有赛灵思发布全球最大的FPGA。Intel发布的两款AI芯片Nervana NNP-T/NNP-I同样备受关注。不过,AMD在Hot Chips期间并没有获得巨大的关注,这或许是因为在当今AI大热的情况下,他们采用“观望式”的AI策略。

Intel、AMD和NVIDIA如何预估AI市场?

NVIDIA预计,其数据中心和人工智能潜在市场(TAM)到2023年将达到500亿美元。这包括HPC(高性能计算),DLT(深度学习训练)和DLI(深度学习推理)。

英特尔估计,其DLT和DLI 潜在市场在2020年将达到460亿美元。

AMD尚未发布任何关于深度学习潜在市场的预测,因为它更专注于从英特尔和NVIDIA获得市场份额。因此,也没有看到AMD有专注于人工智能的芯片。

不过,AMD首席执行官Lisa Su表示,我们正在努力成为人工智能领域更重要的参与者。

Lisa Su:CPU的局限性

任何计算性能的讨论都始于摩尔定律,但摩尔定律正在放缓。摩尔定律指出,随着芯片尺寸缩小和晶体管密度增加,计算性能将每两年翻一番。

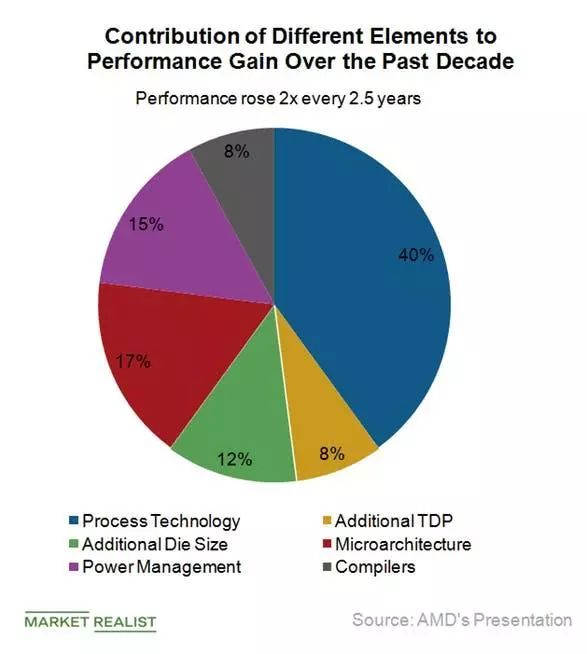

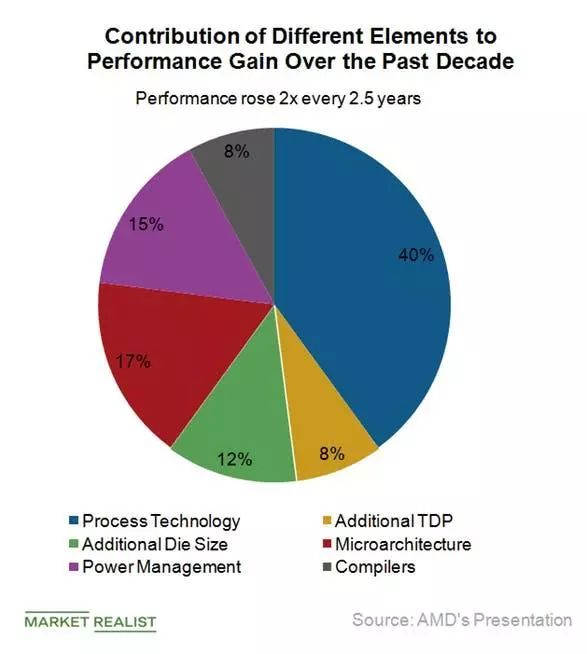

在AnandTech Hot Chips 31的报道指出,Lisa Su在主题演讲中解释说,AMD通过各种方式改善了CPU的性能,包括工艺制程、芯片面积、TDP(热设计功耗)、电源管理、微体系结构和编译器。

先进工艺制程的贡献最大,这使得CPU的性能提升了40%。增加芯片尺寸也可以带来两位数性能的提升,但这不符合成本效益。

AMD通过微体系架构将EPYC Rome服务器CPU IPC(每个周期的指令)在单线程和多线程工作负载中分别提升了23%和15%。高于行业平均5%-8%的水平。上述所有方法在两年半内都会使性能翻倍。

Lisa Su:人工智能所需的加速计算

Lisa Su表示,一方面,摩尔定律正在放缓。另一方面,世界上最快的超级计算机的性能每1.2年翻一番。这意味着过去十年的解决方案将失效。

该行业目前的需求是优化系统的各个部分,使其成为人工智能工作负载的理想选择。她解释说,ASIC和FPGA的每瓦特性能最高,CPU最低。通用GPU在每瓦性能方面介于CPU和FPGA之间。

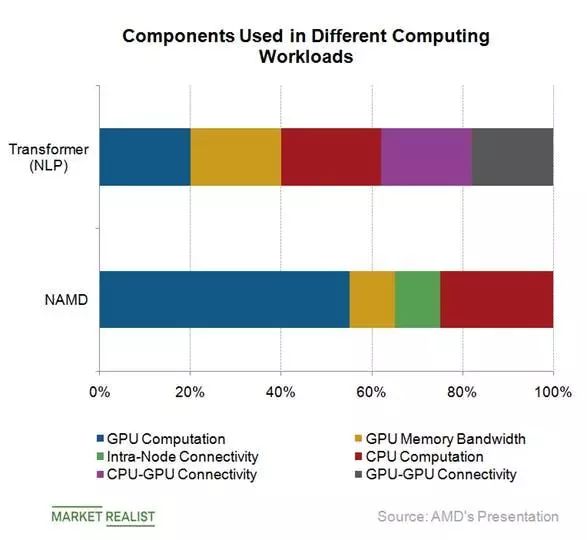

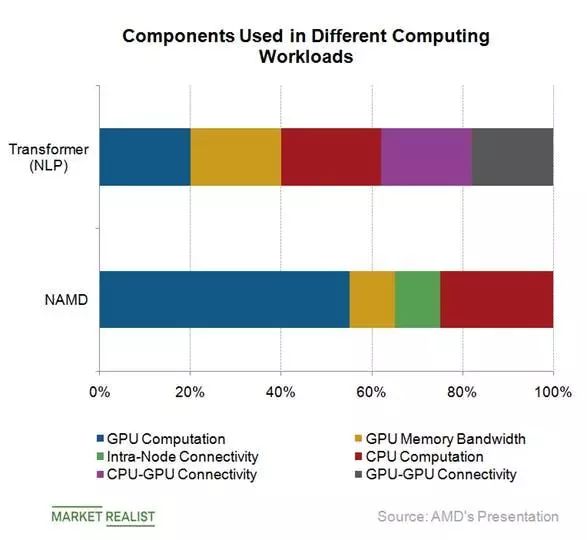

Lisa Su指出,每个人工智能工作负载都有不同的计算要求。互连技术是解决方案,因为它将不同的部分互连到同一个系统。她用以下例子解释了这一点:

NAMD(纳米级分子动力学)工作负载取决于GPU

NLP(自然语言处理)工作负载在CPU、GPU、内存带宽和连接性之间保持平衡

业界使用传统方法提高了CPU和GPU的性能。Lisa Su强调,业界应该通过关注互连,I/O、内存带宽、软件效率和软硬件协同优化来提高性能。

AMD的AI策略

Lisa Su表示,AMD已采用CPU / GPU /互连策略来挖掘人工智能和HPC的机会。她说,AMD将在Frontier超级计算机中使用其所有技术。该公司计划为实现超级计算机全面优化其EYPC CPU和Radeon Instinct GPU。它将通过其Infinity Fabric总线技术进一步增强系统性能,并通过其ROCM(Radeon Open Compute)软件工具解锁性能。

与英特尔和NVIDIA不同,AMD没有专用的人工智能芯片或专用的加速器。尽管如此,苏还指出,“我们绝对会看到AMD在人工智能方面是一个很重要的参与者。”AMD正在考虑是否要建立一个专用的AI芯片,这一决定将取决于人工智能如何发展。

Su补充说,许多公司正在开发不同的人工智能加速器,如ASIC、FPGA和张量(Tensor)加速器。这些芯片将缩小到最可持续的状态,然后AMD将决定是否构建可以广泛应用的加速器。

与此同时,AMD将与第三方加速器制造商合作,并通过其Infinity Fabric互连将其芯片与自己的CPU / GPU连接。这个策略类似于其光线跟踪策略,NVIDIA去年推出了实时光线跟踪,但AMD并没有急于推出这项技术。不过,Su表示AMD将在生态系统完善并且该技术被广泛采用的情况下引入光线跟踪技术。

鉴于AMD是一个相对较小的玩家,与拥有充足资源的大型玩家竞争,上述策略具有经济意义。在已经建立的市场中分享份额可以减少因采用率低而导致产品失败的风险,并保证最低的回报。

AMD AI战略与英特尔和NVIDIA战略的不同

AMD在开发AI芯片之前采用了观望态度。他们现在做的,是利用其现有技术来满足AI工作负载。

英特尔开发了全面的技术,包括Xeon CPU、Optane内存、Altera FPGA和互连技术。也在开发独立GPU Xe。在Hot Chip 31中,英特尔推出了专用于深度学习训练和深度学习推理的Nervana AI芯片。英特尔的芯片由自己生产,虽然这使英特尔能够更好地控制其技术,但需要大量的时间和资源。

NVIDIA的AI策略是提供通用GPU以及可用于任何AI应用程序的CUDA软件支持。它还具有NVLink互连技术。英伟达正与合作伙伴共同探索人工智能新市场。虽然这种策略需要大量研究并且有很高的失败风险,但这些高风险也会带来高回报。

责任编辑:sophie

相关文章

-

- 半导体行业观察

-

- 摩尔芯闻

最新新闻

热门文章 本日 七天 本月

- 1 在这个平台上,硬件创新跑出了“中国速度”

- 2 国产EDA突破,关键一步

- 3 机器人“核芯”企业,一微半导体聚焦“AI+机器人”横琴启程

- 4 MediaTek 发布天玑 8400 移动芯片,开启高阶智能手机全大核计算时代