英伟达最强Blackwell 架构,备受行业青睐!

2024-06-02

23:31:06

来源: 杜芹

点击

在AI发展需求如此迅速的时代,作为时代“弄潮儿”的NVIDIA,前不久宣布,NVIDIA每年都将会设计一次新芯片,节奏由原来的2年一次改为1年一次。“We’re on a one-year rhythm”。在近日召开的台北电脑展上,NVIDIA宣布了新的半导体技术路线图,并首次揭露下一代芯片是Rubin 平台,Rubin 将作为 Blackwell 的下一代平台。

回顾过去,英伟达一直保持着每两年发布一次全新架构的节奏,从2020年的Ampere到2022年的Hopper,再到2024年的Blackwell,每一次架构的更新都为AI应用带来了革命性的提升。H100作为Hopper架构的代表产品,在市场上备受追捧,而B200则是Blackwell架构的最新力作,性能表现更加强劲。

截至目前,NVIDIA Blackwell这个地表最强的GPU架构,为AI应用带来了革命性的提升,它能够使企业在万亿参数大型语言模型上构建和运行实时生成式 AI,其成本和能耗较上一代产品最低可降至 1/25。也因此,Blackwell迅速获得了众多客户的青睐。

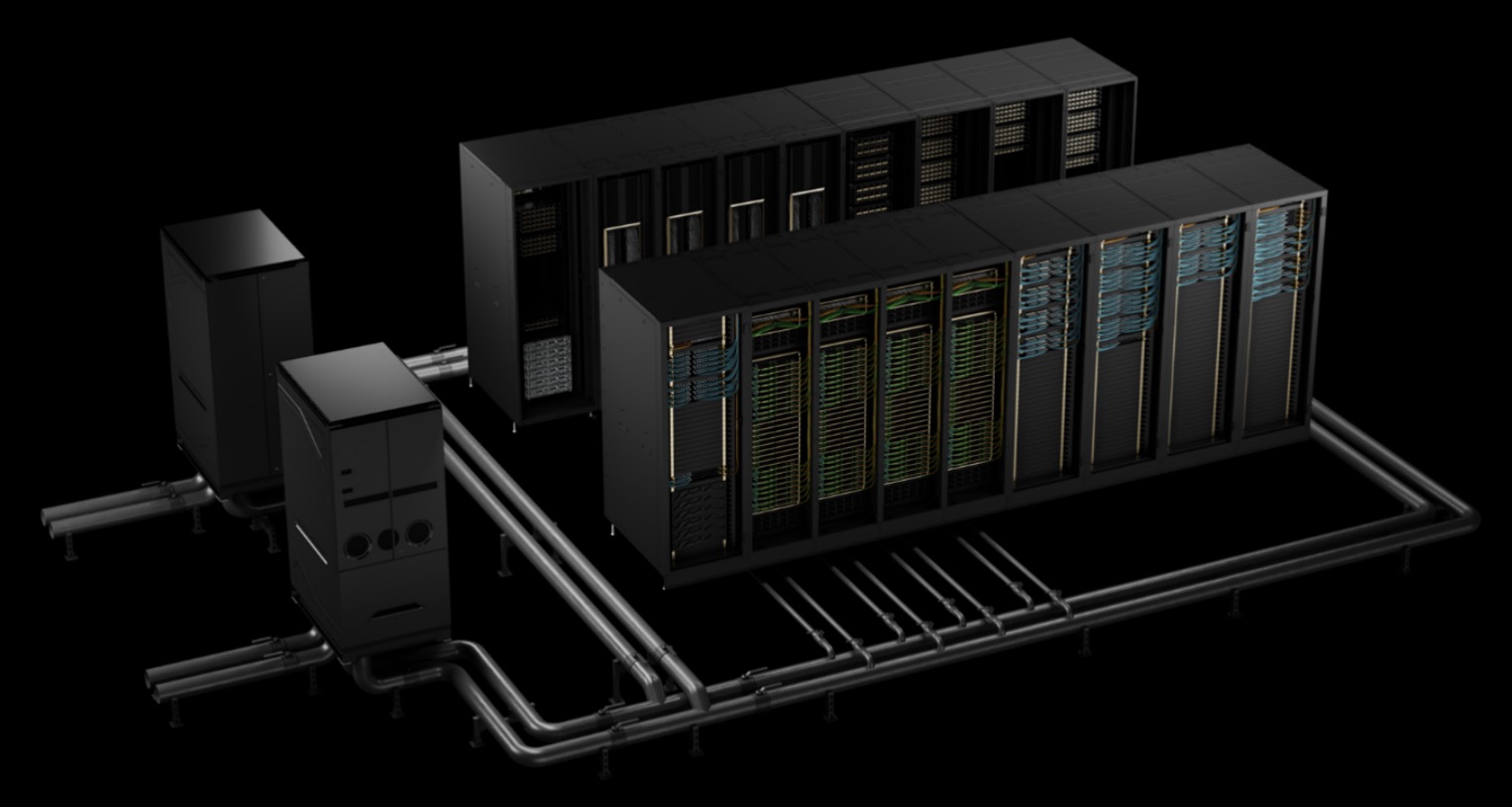

厂商们积极拥抱Blackwell架构

Blackwell平台的发布标志着AI技术的又一次重大突破,目前,Blackwell的产品阵容包括NVIDIA Blackwell Tensor Core GPU、GB200 Grace Blackwell超级芯片、GB200 NVL2和GB200 NVL72。涵盖了从单 GPU 到多 GPU、从 x86 到 Grace、从风冷到液冷技术等。强大的Blackwell产品阵容将推动AI应用在各个领域的广泛普及,为企业带来新的发展机遇。

在近日的台北国际电脑展(COMPUTEX )上,NVIDIA 创始人兼首席执行官黄仁勋宣布,“从服务器、网络和基础设施制造商到软件开发商,整个行业正在准备使用 Blackwell 来加速各个领域实现 AI 驱动的创新。”

台湾地区的一流医疗中心长庚纪念医院计划使用 NVIDIA Blackwell 计算平台推进生物医学研究并加速影像和语言应用,以此改善临床工作流程,提升患者感受。

全球最大电子制造商之一Foxconn 正计划使用 NVIDIA Grace Blackwell 来开发用于 AI 电动汽车和机器人平台的智能解决方案,以及日益增长的基于语言的生成式 AI 服务,以为其客户打造更加个性化的体验。

此外,永擎电子、华硕、技嘉、鸿佰科技、英业达、和硕、QCT、Supermicro、纬创资通和纬颖10家企业都将提供采用 Blackwell 架构的系统,使用 NVIDIA GPU和网络打造云、专用系统、嵌入式和边缘 AI 系统。

NVIDIA MGX支持Blackwell

为了满足全球数据中心多样化的加速计算需求,去年NVIDIA在Computex上发布了Nvidia MGX 模块化参考设计平台,以便其能够以快速且低成本的方式构建超过 100 种的系统设计配置。

今年的Computex大会上,NVIDIA MGX模块化参考设计平台已经加入了对 NVIDIA Blackwell产品的支持,包括全新 NVIDIA GB200 NVL2 平台,该平台专为主流大语言模型推理、检索增强生成和数据处理提供卓越的性能而打造。GB200 NVL2 非常适合用于数据分析等新兴领域,企业每年在这些领域的支出高达数百亿美元。

借助 NVLink®-C2C 互连技术带来的高带宽内存性能和 Blackwell 架构中的专有的解压缩引擎,较使用 x86 CPU 时数据处理速度可提速最多达 18 倍,能效提高了 8 倍。

制造商首先可根据其服务器机箱选择一种基本的系统架构,然后再根据不同的工作负载选择 GPU、DPU 和 CPU。目前,已有超过 25 家合作伙伴的 90 多套已发布或正在开发中的系统使用了 MGX 参考架构,较去年来自 6 家合作伙伴的 14 套系统有了显著的增加。通过采用 MGX,开发成本大幅降低,较之前最多降低了四分之三,开发时间缩短到仅六个月,较之前减少了三分之二。

AMD 和英特尔都支持 MGX 架构,并首次计划打造基于他们自己 CPU 主机处理器的模块设计,其中包括下一代 AMD Turin 平台和基于 P 核心的第六代英特尔®至强®处理器(原 Granite Rapids)。任何服务器系统厂商都可以借助这些参考设计节省开发时间,并确保设计和性能的一致性。

NVIDIA 的最新平台 GB200 NVL2 也采用了 MGX 和 Blackwell。在横向扩展能力上,采用单一节点设计,就可以支持各种不同的系统配置和网络选项,将加速计算无缝集成到现有的数据中心基础设施中。

强大生态系统,助力生成式AI落地部署

英伟达不仅提供各种软硬件产品,还与行业伙伴合作构建了统一的生态系统,为生成式AI的行业部署提供坚强的后盾。

这个生态系统包括全球领先的半导体制造商、NVIDIA的代工合作伙伴TSMC,以及全球电子制造商,它们为AI工厂提供关键组件。这些伙伴公司在服务器、供电、冷却等领域做出了许多创新,例如安费诺、奇鋐科技(AVC)、Cooler Master、Colder Products Company(CPC)、丹佛斯、台达和光宝科技。

得益于强大的生态系统,行业厂商能够快速开发和部署新的数据中心基础设施,以满足全球企业的需求。通过与戴尔科技、慧与、联想等服务器系统合作伙伴合作,并利用Blackwell技术、NVIDIA Quantum-2或Quantum-X800 InfiniBand网络平台、NVIDIA Spectrum™-X以太网平台以及NVIDIA BlueField®-3 DPU,厂商们可以进一步加速数据中心的开发和部署。

企业级用户还可以利用NVIDIA AI Enterprise软件平台,其中包含NVIDIA NIM推理微服务,来创建和运行生产级生成式AI应用。

写在最后

Blackwell正在以迅雷之势席卷整个AI加速器,成为行业首选。按照这个速度,Blackwell很可能即将面临供过于求的局面。相信在英伟达的引领下,AI技术将迎来更加快速的发展,为人类社会带来更加美好的未来。

责任编辑:sophie